Le AI sono sempre più presenti nella nostra vita quotidiana e stanno definendo i confini di una terra per lo più sconosciuta e noi, come designer, ci siamo concentrati su come affrontare questo nuovo scenario e, partendo dalla nostra esperienza, abbiamo trovato cinque regole che ci aiutano a progettare quando ci sono delle AI coinvolte.

Come si progetta la giusta interazione tra un uomo e un intelligenza artificiale? Ma prima ancora, che cosa intendiamo per AI? Scordiamoci entità onniscienti e maligne alla AL9000, ma più semplicemente quelle con cui abbiamo a che fare ogni giorno: il navigatore, i chatbot, gli assistenti virtuali, l’aspirapolvere, i sistemi che ci suggeriscono beni da acquistare o quale serie guardare la sera…

Sono anni che vivono con noi, e sono anni che come studio lavoriamo su sistemi esperti e cognitivi. In questo periodo di tempo, abbiamo sviluppato una serie di riflessioni sull’argomento.

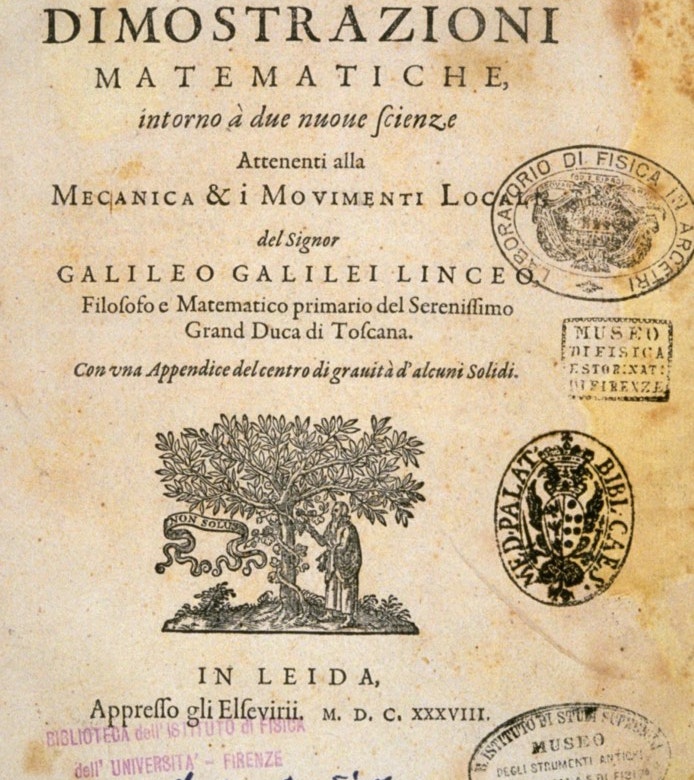

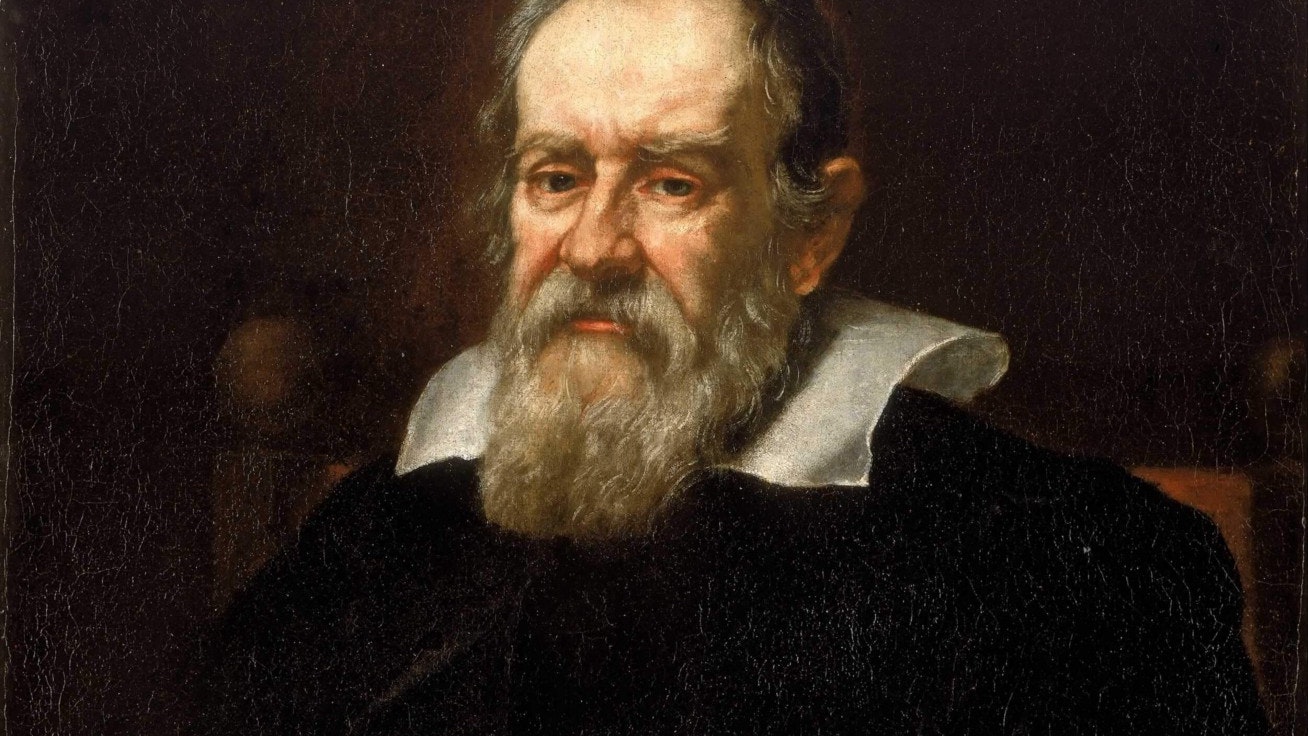

Il nostro viaggio alla ricerca di queste regole parte da un libro, e un libro molto importante per di più perché in esso sono enunciati per la prima volta alcuni degli assiomi della fisica moderna come il movimento rettilineo uniforme, l’idea di inerzia e il momento meccanico. Si tratta delle “Dimostrazioni matematiche intorno a due nuove scienze” scritto nel 1638 da Galileo Galilei, padre della scienza moderna.